Системы хранения данных от А до Я

Добрый день! Уважаем/tipые читатели и гости одного из крупнейших IT блогов в рунете Pyatilistnik.org. Объем данных растет быстрее, чем когда-либо прежде. Новые данные создаются каждую секунду аналитикой больших данных, мобильными устройствами и социальными приложениями. По мере увеличения объема данных предприятия любого размера сталкиваются с такими проблемами, как рост емкости, влияние на производительность и повседневное управление для поддержания и сохранения точности данных в центрах обработки данных или в облаке. Все это ведет к тому, что компаниям необходимо задуматься, о покупке системах ранения данных.

Добрый день! Уважаем/tipые читатели и гости одного из крупнейших IT блогов в рунете Pyatilistnik.org. Объем данных растет быстрее, чем когда-либо прежде. Новые данные создаются каждую секунду аналитикой больших данных, мобильными устройствами и социальными приложениями. По мере увеличения объема данных предприятия любого размера сталкиваются с такими проблемами, как рост емкости, влияние на производительность и повседневное управление для поддержания и сохранения точности данных в центрах обработки данных или в облаке. Все это ведет к тому, что компаниям необходимо задуматься, о покупке системах ранения данных.

Цель статьи – рассмотреть концептуальные основы подходов к построению систем хранения данных. Здесь намеренно не приводится технических характеристик, т.к. к сути они отношения не имеют. Дабы статья не выглядела рекламной брошюрой, не будет и названий продуктов, а также степеней «хороший» и «не имеющий аналогов». Исчерпывающей статью также назвать нельзя, наоборот, я постарался охватить минимально-достаточный материал, доступный для понимания среднему инженеру, никогда не имевшему дело с СХД. Итак, начнем.

Что такое системы хранения данных?

В современном мире, где все больше информации хранится в электронном виде, системы хранения данных играют важную роль. Они позволяют организовать и хранить большие объемы информации, обеспечивают быстрый доступ к данным и защиту от потери или повреждения.

Система хранения данных – это комплекс технологий и программных средств, предназначенных для хранения и обработки информации. Она состоит из нескольких компонентов, каждый из которых выполняет свою функцию:

- Хранилище данных – это физическое устройство, на котором хранятся данные. Это может быть жесткий диск, сетевое хранилище (NAS), облачное хранилище и т.д. Хранилище данных должно обеспечивать надежность, быстродействие и возможность масштабирования.

- Система управления данными (СУБД) – это программный компонент, который управляет доступом к данным и обеспечивает их целостность. СУБД позволяет создавать базы данных, добавлять, изменять и удалять данные, а также выполнять запросы к данным.

- Сеть хранения данных – это инфраструктура, которая обеспечивает передачу данных между компонентами системы хранения данных. Это может быть локальная сеть (LAN), глобальная сеть (WAN) или сеть хранения данных (SAN).

- Программное обеспечение для резервного копирования данных – это компонент, который обеспечивает защиту данных от потери или повреждения. Он создает резервные копии данных и восстанавливает их в случае необходимости.

Системы хранения данных используются в различных областях, включая бизнес, науку, медицину, образование и т.д. Они позволяют хранить большие объемы информации, обрабатывать данные и получать ценную информацию для принятия решений.

Другим примером системы хранения данных является облачное хранилище. Облачное хранилище – это сервис, который позволяет хранить данные в удаленном центре обработки данных. Оно обеспечивает быстрый доступ к данным, защиту от потери и повреждения данных, а также возможность масштабирования.

Системы хранения данных имеют свои преимущества и недостатки. Одним из главных преимуществ является возможность хранить большие объемы информации и быстрый доступ к данным. Недостатком является высокая стоимость и сложность управления системой хранения данных. Давайте немного подробнее поговорим про компоненты.

DAS (Direct Attached Storage)

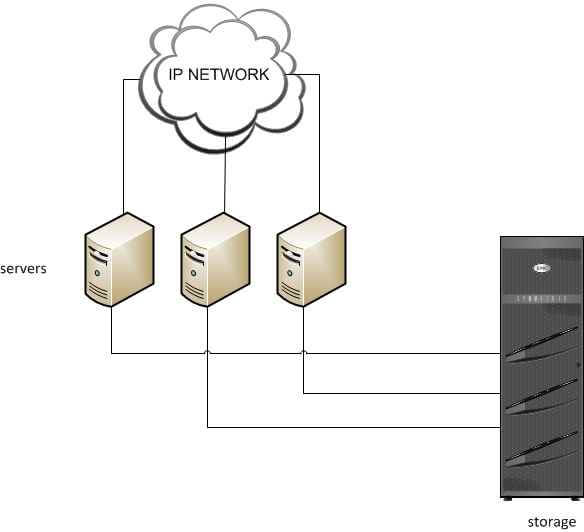

Эта вещь вам давно знакома. Вспомним схему работы с диском обычного PC: материнская плата соединяется с HDD посредством интерфейсов ATA/SATA. Вы уже давно все это знаете, а значит представляете, что такое DAS. Точнее, вы понимаете, что такое архитектура DAS внутреннего типа. Существует также архитектура DAS внешнего типа, которая отличается от внутренней допустимым расстоянием между, вообще говоря, несколькими серверами и устройством хранения.

Возможность внешнего подключения достигается благодаря использованию технологий SCSI и FC. Если не вдаваться в детали перечисленных технологий передачи данных, это, пожалуй, все, что можно сказать про DAS.

Из принципиальной простоты архитектуры DAS следуют основные ее преимущества: наименьшая цена по сравнению с остальными, рассмотренными ниже и относительная простота внедрения. Кроме того, такой конфигурацией легче управлять ввиду хотя бы того, что число элементов системы мало. Целостность данных в DAS обеспечивается применением старой и популярной технологии RAID.

Однако такое решение подойдет для относительно некритичных задач и ограниченного числа рабочих станций. Совместное использование конечных вычислительных ресурсов накладывает ряд ограничений. Количество одновременно подключенных машин не превышает числа портов в устройстве хранения, ограниченная пропускная способность увеличивает время чтения-записи (IO), неэффективное использование кеша и т.д.

Частично проблемы производительности могут быть решены парком серверов (например разделенные по типу обрабатываемых запросов), каждый из которых нагружает отдельное устройство хранения.

Однако и у этой схемы начинаются трудности, когда возникает необходимость разделять данные между серверами, или объем занимаемой памяти оказывается неравномерным. Очевидно, что в таких условиях DAS не отвечает требованиям масштабируемости и отказоустойчивости, по этой причине были придуманы NAS и SAN.

NAS (Network Attached Storage)

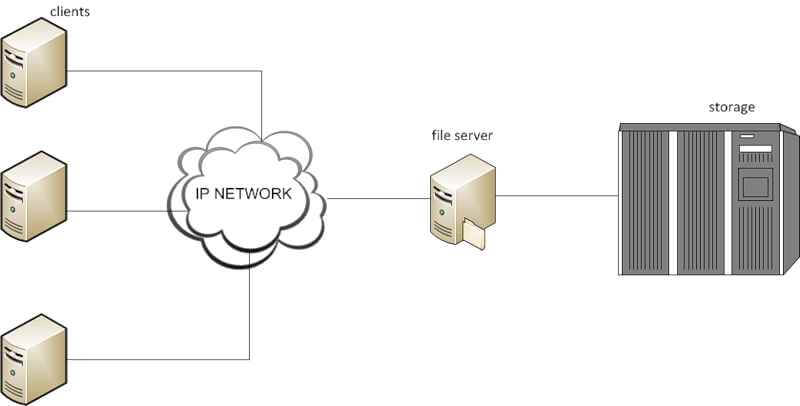

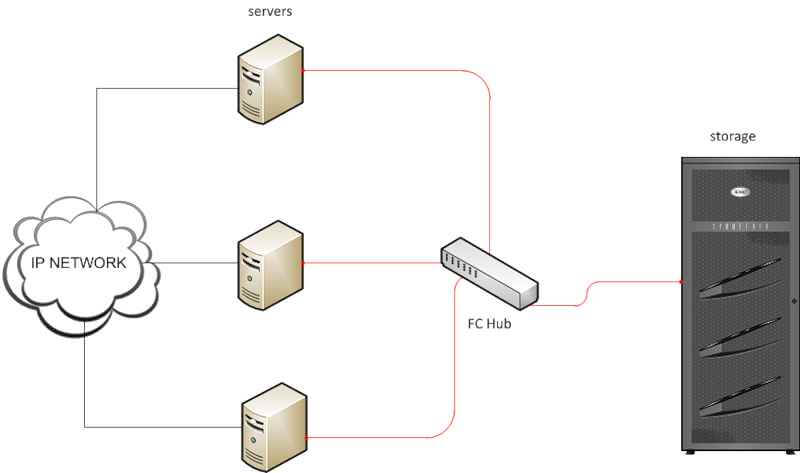

Представим себе сервер в локальной сети, который не делает ничего, кроме как расшаривает свои папки. Это практически и есть NAS. Да, NAS – это всего лишь устройство для файлового обмена в IP сети. Минимальная конфигурация NAS выглядит так:

О структуре. NAS-устройство (файл-сервер) – это выделенный высокопроизводительный сервер, имеющий собственную ОС, оптимизированную для операций чтения/записи. Сервер имеет несколько сетевых интерфейсов для связи с IP сетью и устройством хранения: GigabitEthernet, FastEthernet, FDDI и проч. Кроме того, NAS обладает большим объемом оперативной памяти, большая часть которой используется как кеш, что позволяет выполнять операцию записи асинхронно, а чтение ускорить за счет буферизации. Таким образом, данные могут долгое время находится в оперативной памяти, не попадая на диск. NAS позволяет централизованно хранить данные и предоставляет удаленный доступ к ним всем авторизованным пользователям, независимо от типа клиентского устройства.

Storage (дисковый массив) – то, что чаще всего изображается в статьях, где речь идет о дата-центрах. Другими словами это шкаф (стойка) с дисками, соединенный (или интегрированный) с файл-сервером. Интегрированный? Да, NAS может быть отдельным сервером (как на рисунке) или входить в состав цельного устройства. В первом случае имеем дело с gateway реализацией NAS, во втором – с монолитной системой. О gateway реализации мы еще вспомним, когда будем говорить о SAN.

Как работает NAS? NAS поддерживает работу с протоколами шаринга CIFS и NFS. Клиент монтирует у себя файловую систему, предоставляемую NAS'ом и выполняет операции чтения/записи в обычном файловом режиме, а сервер NAS их обрабатывает, переводя на язык блочного доступа, понятный стораджу. Кроме этого, поддерживаются такие протоколы, как FTP, DFS, SMB.

Системы NAS популярны среди предприятий и малых предприятий во многих отраслях как эффективные, масштабируемые и недорогие решения для хранения данных. Их можно использовать для поддержки систем электронной почты, бухгалтерских баз данных, расчета заработной платы, записи и редактирования видео, регистрации данных, бизнес-аналитики и многого другого; NAS-системы поддерживают множество других бизнес-приложений.

Учитывая гибкость и популярность систем NAS, большинство поставщиков облачных услуг предлагают услуги NAS; Это позволяет смешивать и сочетать системы хранения NAS и облачные сервисы в бизнесе, позволяя оптимизировать затраты, усилия по управлению и производительность, давая бизнесу полный контроль над местоположением и безопасностью.

Какой профит от использования NAS и почему типовому решению нужно отводить целый класс?

- ✅Во-первых, операции IO занимают меньше времени, следовательно, NAS работает существенно быстрее, чем сервера «общего назначения», так если в вашей архитектуре есть сервер, который должен отдавать много статики, стоит подумать об использовании NAS.

- ✅Во-вторых, централизованное хранение проще в управлении.

- ✅В-третьих, общее увеличение емкости NAS происходит прозрачно для клиентов, все операции добавления/удаления памяти скрыты от потребителей.

- ✅В-четвертых, предоставление доступа на уровне файловой системы позволяет вводить понятие привилегий rwx. Забегая вперед, можно отметить, что при помощи NAS без ущерба пропускной способности легко организовать мультисайтововсть (о том, что это такое мы расскажем, когда речь пойдет о репликации).

- ✅Системы NAS отличаются высокой гибкостью и масштабируемостью, позволяя устанавливать новые накопители в дополнение к уже имеющимся

Но есть и ряд ограничений, связанных с использованием NAS. В основном это связано с базовым для NAS принципом. Сама по себе избыточность TCP/IP как протокола доступа к данным приводит к накладным расходам. Высокая нагрузка на сеть с довольно ограниченной пропускной способностью увеличивает время отклика. Производительность системы в целом зависит не только от NAS, но и от качества работы коммутирующих устройств сети. Кроме того, без правильного resource allocation, клиент, запрашивающий слишком большие объемы файлов, может влиять на скорость работы других клиентов

SAN (Storage Area Network)

Здесь аналогии с enthernet я не придумал :(. SAN (сеть хранения данных) – это инфраструктура блочного хранения данных, построенная на базе высокоскоростной сети. Как видно из определения, основное отличие от NAS заключается в предоставлении доступа к данным на блочном уровне. Если же сравнивать SAN и DAS, ключевым понятием здесь является сеть. Так, среди основных компонентов SAN те же компоненты, но от прочих архитектур ее отличает наличие специальных коммутаторов, поддерживающих передачу данных по FibreChannel или (Fast- GB- etc.) Ethernet:

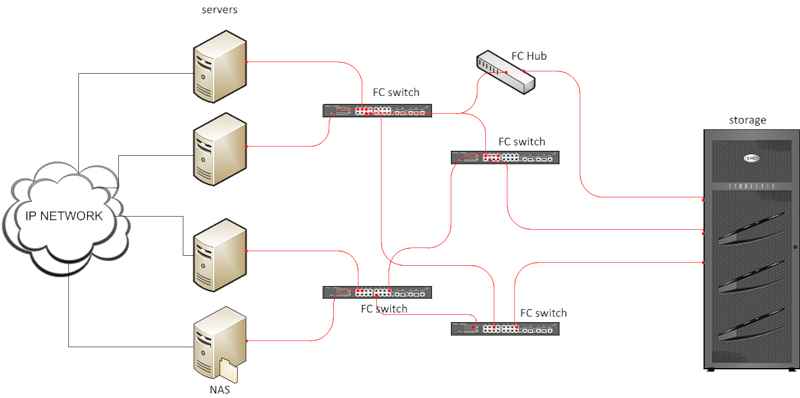

История SAN начинается с конца 1980-х, когда впервые была предложена идея построения FC сети. В ранних реализациях в качестве коммутирующего устройства использовались хабы, такой подход называется управляемой петлей (Arbitrated Loop, далее FC-AL):

Схема взаимодействия в FС-AL аналогична CSMA/CA: каждый раз, когда какой-либо узел в FC-AL собирается выполнить операцию IO, он посылает блокирующий пакет, оповещая всех о начале передачи. Когда пакет возвращается отправителю, узел получает полный контроль над петлей для проведения операции. По окончанию операции все узлы оповещаются об освобождении канала и процедура повторяется. Очевидно, что такая ситуация ничем не лучше DAS, а к проблемам пропускной способности добавляется еще одна: в каждый момент времени только один клиент может выполнять операцию IO. Кроме того, использование 8-битной адресации в FC-AL позволяет иметь не более 127 устройств в сети. Короче говоря, FС-AL оказался ничем не лучше DAS.

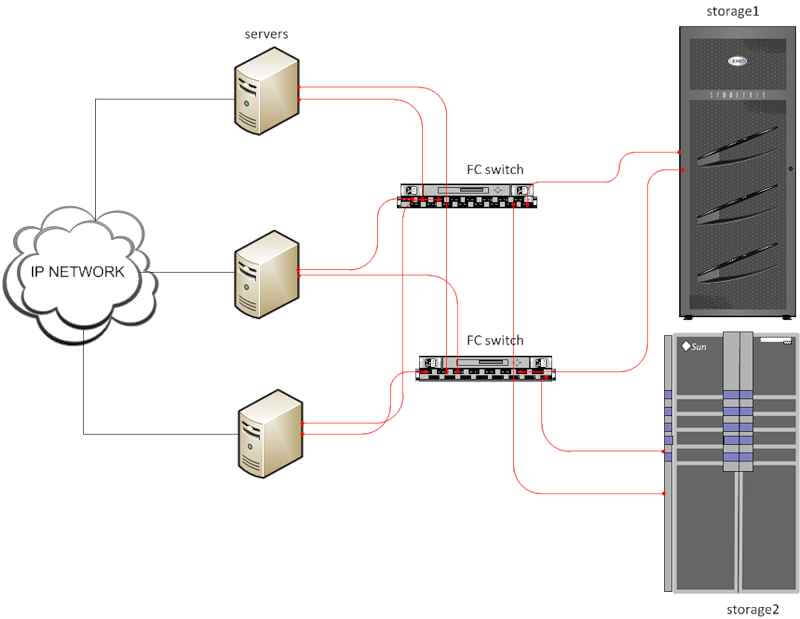

На смену FC-AL пришла архитектура, название которой я не стану переводить: FC-Switched Fabric (FC-SW). Именно эта реализация SAN дошла до наших дней. В FC-SW вместо хаба используется один или несколько коммутаторов, таким образом данные предаются не по разделяемому, а по индивидуальным каналам.

Как и в Ethernet на базе этих коммутаторов можно построить множество топологий, в частности, к корневому (-ым) может быть подключен другой коммутатор или хаб:

Преимущества SAN очевидны:

- ✅общий объем памяти может расти не только за счет увеличения емкости существующих сторожей, но и за счет добавления новых;

- ✅каждый хост может работать с любым устройством хранения, а не только со своим, как в случае с DAS;

- ✅сервер имеет несколько «путей» получения данных (multipathing), поэтому, при правильно построенной топологии, даже после выхода из строя одного из коммутаторов система останется рабочей;

- ✅есть такая опция, как Boot From SAN, это означает что серверу теперь даже не нужен собственный загрузочный диск;

- ✅существует опция zoning, позволяющая разграничивать доступ серверов к ресурсам;

- ✅отчасти решена проблема с пропускной способностью – отчасти, т.к. узким местом по-прежнему остается канал между устройством хранения и коммутатором, однако, такие операции, как например резервное копирование не оказывают влияния на всю сеть.

Еще одно важное преимущество SAN, о котором нужно сказать отдельно. Гибкая архитектура и предоставление доступа на блочном уровне позволяют построить множество различных решений в зависимости от задачи. Например, если мы снабдим один из серверов специальной ОС, мы получим не что иное, как gateway-реализацию NAS (см. рис. выше), таким образом в рамках решения для одного предприятия могут сочетаться и DAS, и NAS, и SAN.

Но нельзя без ложки дегтя. Один из главных недостатков SAN – это цена. Оставим цифры маркетологам, отметим только что SAN могут себе позволить далеко не все.

Что такое LUN?

LUN (Logical Unit Number) - это логический адрес, который используется для идентификации виртуального устройства хранения данных, такого как дисковый массив или хранилище. LUN позволяет операционной системе обращаться к виртуальному устройству, как если бы это был физический диск, и выполнять операции чтения и записи данных на него. LUN может быть создан на основе одного или нескольких физических дисков, объединенных в логический массив. Это обеспечивает более эффективное использование ресурсов хранилища данных и упрощает процесс управления хранилищем. LUN также позволяет управлять доступом к данным, устанавливать права доступа и контролировать использование ресурсов.

Зонинг в СХД

Зонинг в СХД (системах хранения данных) является методом управления доступом к ресурсам хранилища данных и предоставления виртуальных дисков для серверов. Он позволяет создавать логические группы устройств, которые могут быть доступны только определенным серверам или группам серверов. Это обеспечивает более эффективное использование ресурсов хранилища данных и упрощает процесс управления хранилищем. Зонинг может быть реализован на различных уровнях в СХД, включая уровень физических портов, уровень дисковых массивов и уровень логических разделов. На каждом уровне зонинг позволяет определить, какие серверы или группы серверов имеют доступ к определенным ресурсам хранилища данных.

Один из основных преимуществ зонинга заключается в том, что он позволяет повысить безопасность данных. Зона может быть настроена таким образом, чтобы только определенные серверы имели доступ к определенным ресурсам хранилища данных. Это означает, что если один из серверов в зоне будет скомпрометирован, данные, находящиеся в других зонах, останутся защищенными. Зонинг также позволяет повысить производительность хранилища данных. Когда сервер запрашивает доступ к ресурсам хранилища данных, он должен пройти через процесс аутентификации и авторизации, который может занять некоторое время. Зонинг позволяет оптимизировать этот процесс, уменьшая количество запросов на аутентификацию и авторизацию.

Наконец, зонинг позволяет упростить управление хранилищем данных. Поскольку каждая зона может быть настроена отдельно, администраторы могут быстро и легко изменять права доступа к ресурсам хранилища данных для различных серверов и групп серверов. В целом, зонинг является важным инструментом для управления доступом к ресурсам хранилища данных и обеспечения безопасности и производительности в СХД. Он позволяет оптимизировать использование ресурсов хранилища данных и упрощает процесс управления хранилищем.

СХД компании Dell

Фирма Dell предлагает широкий модельный ряд систем хранения данных, который включает в себя как малые, так и крупные решения для бизнеса. Каждая модель обладает своими уникальными характеристиками и предназначена для определенных задач. Системы хранения данных Dell PowerVault – это решения для малого и среднего бизнеса. Они обеспечивают надежное хранение данных, быстрый доступ к ним и простоту управления. В модельном ряде Dell PowerVault можно найти как локальные, так и сетевые хранилища данных (NAS).

- Системы хранения данных Dell EMC Unity – это решения для среднего и крупного бизнеса. Они обеспечивают высокую производительность, надежность и масштабируемость. Системы Dell EMC Unity поддерживают все основные протоколы хранения данных, включая iSCSI, Fibre Channel и NFS.

- Системы хранения данных Dell EMC PowerMax – это решения для крупных корпораций и организаций. Они обладают высочайшей производительностью, надежностью и масштабируемостью. Системы Dell EMC PowerMax поддерживают все основные протоколы хранения данных, включая NVMe, Fibre Channel и iSCSI.

- Системы хранения данных Dell EMC Isilon – это решения для обработки больших объемов данных. Они обеспечивают высокую производительность и масштабируемость, а также поддерживают все основные протоколы хранения данных, включая NFS, SMB и HDFS.

- Системы хранения данных Dell EMC VMAX – это решения для крупных корпораций и организаций, которые требуют высочайшей производительности и надежности. Они обладают масштабируемостью до нескольких петабайт и поддерживают все основные протоколы хранения данных, включая NVMe, Fibre Channel и iSCSI.

СХД компании NetApp

Фирма NetApp – это один из лидеров рынка систем хранения данных. Компания предлагает широкий модельный ряд решений, который включает в себя как малые, так и крупные системы для бизнеса. Каждая модель обладает своими уникальными характеристиками и предназначена для определенных задач.

- Системы хранения данных NetApp FAS – это решения для малого и среднего бизнеса. Они обеспечивают надежное хранение данных, быстрый доступ к ним и простоту управления. В модельном ряде NetApp FAS можно найти как локальные, так и сетевые хранилища данных (NAS).

- Системы хранения данных NetApp AFF – это решения для среднего и крупного бизнеса. Они обеспечивают высокую производительность, надежность и масштабируемость. Системы NetApp AFF используют технологию Flash, что обеспечивает высокую скорость работы.

- Системы хранения данных NetApp E-Series – это решения для крупных корпораций и организаций. Они обладают высочайшей производительностью, надежностью и масштабируемостью. Системы NetApp E-Series поддерживают все основные протоколы хранения данных, включая iSCSI, Fibre Channel и SAS.

- Системы хранения данных NetApp SolidFire – это решения для обработки больших объемов данных. Они обеспечивают высокую производительность и масштабируемость, а также поддерживают все основные протоколы хранения данных, включая iSCSI и Fibre Channel.

СХД компании HP

Фирма HP (Hewlett-Packard) – это один из крупнейших производителей компьютерной техники и решений для хранения данных. Компания предлагает широкий модельный ряд систем хранения данных, который включает в себя как малые, так и крупные системы для бизнеса. Каждая модель обладает своими уникальными характеристиками и предназначена для определенных задач.

- Системы хранения данных HP StoreEasy – это решения для малого и среднего бизнеса. Они обеспечивают надежное хранение данных, быстрый доступ к ним и простоту управления. В модельном ряде HP StoreEasy можно найти как локальные, так и сетевые хранилища данных (NAS). Эти системы поддерживают такие протоколы, как SMB и NFS, что делает их идеальным выбором для организаций, использующих Windows или Linux.

- Системы хранения данных HP StoreVirtual – это решения для среднего и крупного бизнеса. Они обеспечивают высокую производительность, надежность и масштабируемость. Системы HP StoreVirtual используют технологию виртуализации, что позволяет объединять несколько физических серверов в единую систему хранения данных. Это обеспечивает высокую доступность и упрощает управление данными.

- Системы хранения данных HP 3PAR – это решения для крупных корпораций и организаций. Они обладают высочайшей производительностью, надежностью и масштабируемостью. Системы HP 3PAR поддерживают все основные протоколы хранения данных, включая iSCSI, Fibre Channel и SAS. Они также обладают функциями автоматического балансирования нагрузки и миграции данных, что позволяет эффективно управлять большими объемами информации.

- Системы хранения данных HP StoreServ – это решения для обработки больших объемов данных. Они обеспечивают высокую производительность и масштабируемость, а также поддерживают все основные протоколы хранения данных, включая iSCSI и Fibre Channel. Системы HP StoreServ также обладают функциями автоматического балансирования нагрузки и миграции данных, что позволяет эффективно управлять большими объемами информации.

СХД компании Huawei

Фирма Huawei – это крупнейший китайский производитель компьютерной техники и решений для хранения данных. Компания предлагает широкий модельный ряд систем хранения данных, который включает в себя как малые, так и крупные системы для бизнеса. Каждая модель обладает своими уникальными характеристиками и предназначена для определенных задач.

- Системы хранения данных Huawei OceanStor – это решения для среднего и крупного бизнеса. Они обеспечивают высокую производительность, надежность и масштабируемость. Системы Huawei OceanStor используют технологии хранения данных, такие как RAID, SSD, SAS и NAS, что позволяет обеспечить высокую доступность и упрощает управление данными.

- Системы хранения данных Huawei OceanStor Dorado – это решения для крупных корпораций и организаций. Они обладают высочайшей производительностью, надежностью и масштабируемостью. Системы Huawei OceanStor Dorado используют технологии хранения данных, такие как NVMe и SSD, что позволяет обеспечить высокую скорость работы и ускорить обработку данных.

- Системы хранения данных Huawei OceanStor DJ – это решения для обработки больших объемов данных. Они обеспечивают высокую производительность и масштабируемость, а также поддерживают все основные протоколы хранения данных, включая iSCSI и Fibre Channel. Системы Huawei OceanStor DJ также обладают функциями автоматического балансирования нагрузки и миграции данных, что позволяет эффективно управлять большими объемами информации.

- Системы хранения данных Huawei OceanStor Pacific – это решения для обработки данных в облаке. Они обеспечивают высокую производительность и масштабируемость, а также поддерживают все основные протоколы хранения данных, включая iSCSI и Fibre Channel. Системы Huawei OceanStor Pacific также обладают функциями автоматического балансирования нагрузки и миграции данных, что позволяет эффективно управлять большими объемами информации в облаке.

СХД компании IBM

Фирма IBM – это один из ведущих мировых производителей компьютерной техники и решений для хранения данных. Компания предлагает широкий модельный ряд систем хранения данных, который включает в себя как малые, так и крупные системы для бизнеса. Каждая модель обладает своими уникальными характеристиками и предназначена для определенных задач.

- Системы хранения данных IBM FlashSystem – это решения для среднего и крупного бизнеса. Они обеспечивают высокую производительность, надежность и масштабируемость. Системы IBM FlashSystem используют технологии хранения данных, такие как RAID, SSD, SAS и NAS, что позволяет обеспечить высокую доступность и упрощает управление данными.

- Системы хранения данных IBM DS8000 – это решения для крупных корпораций и организаций. Они обладают высочайшей производительностью, надежностью и масштабируемостью. Системы IBM DS8000 используют технологии хранения данных, такие как NVMe и SSD, что позволяет обеспечить высокую скорость работы и ускорить обработку данных.

- Системы хранения данных IBM Spectrum Scale – это решения для обработки больших объемов данных. Они обеспечивают высокую производительность и масштабируемость, а также поддерживают все основные протоколы хранения данных, включая iSCSI и Fibre Channel. Системы IBM Spectrum Scale также обладают функциями автоматического балансирования нагрузки и миграции данных, что позволяет эффективно управлять большими объемами информации.

- Системы хранения данных IBM Cloud Object Storage – это решения для обработки данных в облаке. Они обеспечивают высокую производительность и масштабируемость, а также поддерживают все основные протоколы хранения данных, включая iSCSI и Fibre Channel. Системы IBM Cloud Object Storage также обладают функциями автоматического балансирования нагрузки и миграции данных, что позволяет эффективно управлять большими объемами информации в облаке.

Вместо заключения

Очень кратко были рассмотрены основные подходы к построению систем управления данными. Здесь не затронуты такие понятия, как IP SAN или CAS, ничего не сказано про iSCSI и про технологии передачи в целом – пока оставим это для самостоятельного чтения. Очень поверхностно сказано о защите данных от потерь, способах резервного копирования, что делать, если сгорел датацентр, короче говоря о внештатных ситуациях (disasters) – они-то и станут предметом нашего следующего обзора. Материал сайта pyatilistnik.org.